Pero, ¿cómo funciona la IA?

Tiempo de lectura: 3 minutos

La autoconciencia, o la capacidad de comprenderse y explicarse a uno mismo, es una de las mayores divisiones entre la inteligencia artificial y la inteligencia humana.

Libre aprendizaje

Sobre el aprendizaje de las IAs, Kate Saenko, profesora de informática de la Universidad de Boston, dice que "no diseñamos redes neuronales en el sentido tradicional, solo diseñamos sus algoritmos de aprendizaje y les suministramos datos. El resto lo aprenden solos”.

Esas es la clave de los problemas con las IAs, no les estamos indicando qué es lo que deben aprender de los datos y cómo lo han de organizar. Este problema afecta al corazón mismo del aprendizaje automático: cuando el algoritmo aprende, toma datos, como fotografías de humanos realizando tareas junto a fragmentos de texto, extrae la información importante y luego clasifica esos fragmentos en constelaciones de datos que solo él puede entender en su totalidad.

Aprender de los errores

Aunque tenemos algoritmos que se utilizan para etiquetar imágenes y cuyo funcionamiento es bueno, no tenemos claro cómo funcionan. Y esto impide que podamos corregirlos cuando se equivocan como en el caso de Google en que se marcaba a gente de color como gorilas. Este también es un gran debate sobre el sesgo en el entrenamiento de las IAs, pero si una IA puede explicarse, entonces podemos decirle cómo corregirse.

Autoexplicarse

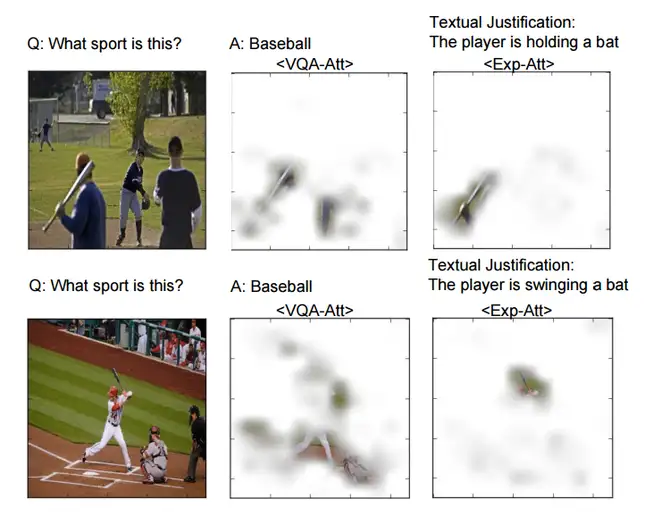

Una nueva investigación de la Universidad de California y el Instituto Max Planck de Informática podría llevarnos a una solución: una IA que analice los datos de dos maneras: una para responder a la pregunta original y otra que identifique los datos utilizados para responder a la pregunta, de manera que lo pueda traducir a lenguaje humano. Es decir, el algoritmo está entrenado en dos conjuntos de información, uno para determinar qué sucede en una imagen y el otro orientado a responder "por qué" se interpreta la imagen de esa manera.

Cuando se le pide a la red neuronal que explique por qué dice que una imagen muestra un partido de béisbol, analiza los datos utilizados para tomar esa decisión, identifica un bate y luego a una persona en una posición en que mueve el bate y dice: " El jugador está golpeando con un bate”.

Los investigadores lo llaman un sistema de “pointing and justification”, ya que puede señalar los datos utilizados para tomar una decisión y justificar por qué se utilizaron de esa manera. Aunque, la verdad, es complicado de darle un sentido.

El problema del carro

Si consideramos que el exceso de parámetros en las IAs es uno de los motivos por los que se hace tan opaco desentrañar la lógica del almacenamiento de la información procesada por la red neuronal, entonces necesitamos un mecanismo para comprenderlo.

Pongamos de ejemplo el dilema del atropellamiento. Suponemos un coche inteligente que se enfrenta a la decisión de provocar un accidente atropellando a un peatón y salvar la vida del conductor o bien, esquivar al peatón estrellándose y accidentar al pasajero.

En el caso de un conductor humano, decida lo que decida, siempre puede explicar su decisión. En cambio, una IA actuará pero no podemos saber qué es lo que va a decidir porque no sabe explicarse. Peor aún, no lo vamos a entender. No creo que, hoy en día, podamos darles el control.

- Estudio para autoexplicarse

https://arxiv.org - Caso de Google

https://www.wsj.com - Problema del carro

https://plato.stanford.edu