Entropía e inteligencia artificial

Tiempo de lectura: 3 minutos

Aunque la entropía es un concepto termodinámico, se ha consiguido realizar cálculos de entropía donde el aumento de la entropía se podría utilizar para simular comportamientos inteligentes.

Introducción

En una charla sobre entropía en los sistemas físicos, el ponente, Javier García, acaba dando algunas referencias de los usos de la entropía e incluye la mención de la inteligencia artificial. ¿Cómo? ¿Qué tiene que ver la entropía con la IA?

Comenta Javier García que "es un tema reciente del que todavía no se ha desarrollado mucho y no sabemos hasta dónde puede llegar, pero parece prometedor." Veamos.

La entropía

En la escuela siempre se ha explicado el concepto de entropía como el grado de desorden de un sistema. Y que, según la segunda ley de la termodinámica, el sistema evoluciona a un estado más desordenado, de máxima entropía.

Pero existe otras formas de definir la entropía. Una de ellas es por el número de microestados de un sistema. Los microestados son el número de diferentes disposiciones posibles de posición molecular y energía cinética en un estado termodinámico particular.

Se representa de esta manera: S = k lnW, donde la entropía, S, es la constante de Boltzman, k, por el logaritmo neperiano de los posibles microestados, W.

Otra forma es la aleatoriedad de un sistema, cuantos más macroestados y microestados definen a un sistema, mayor es la entropía.

Informática y entropía

En informática, la entropía es la aleatoriedad que se puede obtener para usos como la criptografía. Y también se basa en los posibles microestados en que puede estar un dispositivo, como una fuente de audio, o de vídeo que va registrando un sistema físico a medida que aumenta su entropía física.

Además existen algoritmos basados en la entropía que se utilizan para compresión de datos. Como cuántas preguntas de 'sí' o 'no' se necesitan para averiguar un número de 1 a N. Y la solución es que N es mayor o igual a la entropía, basada en la probabilidad del número.

Información y entropía

La entropía es una medida de cualquier tipo de incertidumbre que está presente en los datos, y la ganancia de información indica cuánta información nos brinda una característica particular o una variable particular sobre los resultados finales.

La ganancia de información es el logaritmo neperiano de la probabilidad de que ocurra un estado, en realidad, la suma de las probabilidades de cada microestado, cambiando el signo para no tener información negativa: I = -ln(p). Por lo tanto, la entropia es el promedio de la ganancia de información.

Inteligencia artificial y entropía

En un artículo técnico de A. D. Wissner-Gross, C. E. Freer, «Causal Entropic Forces» se detalla que, «avances recientes en campos que van desde la cosmología hasta la informática han insinuado una posible conexión profunda entre la inteligencia y la maximización de la entropía, pero aún no se ha establecido ninguna relación física formal entre ellas.»

Usando el concepto de ‘entropía a futuro’ e intentando maximizar dicha entropía para tener zonas con el máximo número de posibles estados, se puede calcular teóricamente la fuerza que hay que aplicar a los grados de libertad de los microestados del sistema para conseguirlo.

Un móvil se orientará y avanzará en la dirección donde se ha calculado el la entropia màxima, la posición más estable, y repetirá el proceso a cada movimiento.

Puesta en práctica

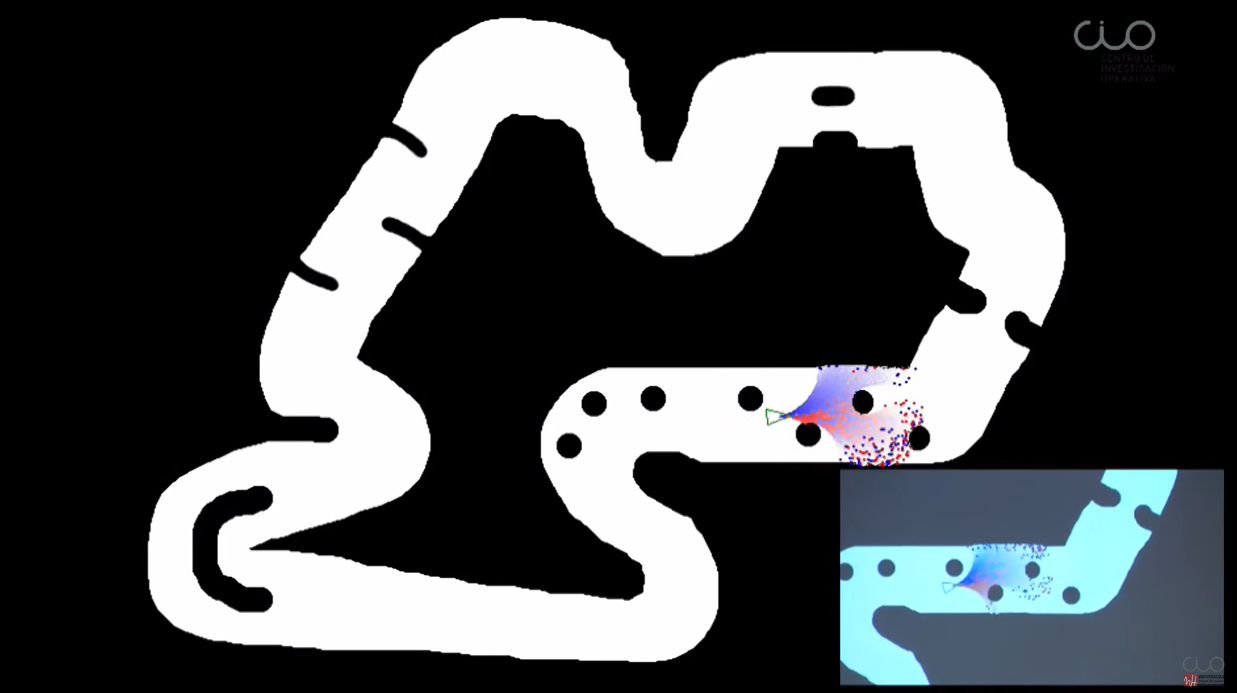

Sergio Hernández Cerezo, matemático por la Universidad de Valencia, ha aplicado la idea a coches simulados en un circuito curvo con obstáculos. El coche toma dos decisiones, girar el volante 5 grados a derecha o izquierda. Se recuentan las posibles posiciones futuras a derecha e izquierda, a las que se puede llegar, para determinar hacia dónde girará.

Si se cuentan n futuros posibles a la izquierda y m futuros posibles a la derecha, entonces se rota el volante (+5) n/(n+m) + (-5) m/(n+m) grados, es decir, la probabilidad de cada zona. Con este algoritmo el coche se mueve siguiendo el circuito, sin chocar. El coche se mueve hacia donde tiene más opciones de futuro estable; si en cierta dirección solo puede pasar por un lugar, prefiere cambiar de dirección hacia donde tenga muchas opciones. Lo cual parece inteligente.

A partir de aquí, Sergio lo calibró para puntuar más ciertas opciones de elección de manera que una posición futura más alejada sea más valorada que una cercana, con poco recorrido.

- Casual Entropic Forces

https://www.alexwg.org - Inteligencia artificial basada en la entropía

https://francis.naukas.com - inteligencia orgánica

https://www.jotdown.es - Entropic and Fractal Intelligence

http://entropicai.blogspot.com - Conferencia

https://youtu.be