Modelo o1 de OpenAI

Tiempo de lectura: 3 minutos

Según OpenAI, lanzadora del nuevo modelo de lenguaje, o1 “pensará” antes de ofrecer una respuesta, “igual que lo haría una persona”. Además, con el paso del tiempo refinará su pensamiento y también reconocerá sus errores.

Noam Brown

En un post de X, Noam Brown comenta:

OpenAI's o1 thinks for seconds, but we aim for future versions to think for hours, days, even weeks. Inference costs will be higher, but what cost would you pay for a new cancer drug? For breakthrough batteries? For a proof of the Riemann Hypothesis? AI can be more than chatbots

Noam Brown

El modelo o1 de OpenAI piensa durante segundos, pero nuestro objetivo es que las versiones futuras piensen durante horas, días e incluso semanas. Los costos de inferencia serán mayores, pero ¿qué precio pagarías por un nuevo medicamento contra el cáncer? ¿Por baterías innovadoras? ¿Por una prueba de la hipótesis de Riemann? La IA puede ser más que chatbots

Noam Brown

Contexto

Actualmente, para los modelos de lenguaje basados en GPT lo más importante es siempre responder a las preguntas lo antes posible ya que el proceso es costoso. Pero en el caso de este modelo, la prioridad es buscar la mejor respuesta, lo que equivale a comprobar las respuestas y pensar lo que se responde. Pero no solo la respuesta final, sino el proceso de generación de la respuesta.

El problema

En los modelos generales que estamos utilizando, se producen situaciones de alucinaciones, que son respuestas que no tiene nada que ver con la pregunta o que no son en absoluto correctas o lógicas. Esto se debe a que el modelo está creando una respuesta en base a los datos de que dispone, sin evaluar la semántica ni la lógica del contenido. Además, tenemos los contenidos peligrosos que pueden generar.

Cuando le haces una pregunta a ChatGPT, sobre todo con temas como programación o matemáticas, es posible que diga algo que no es verdad, aunque lo razone de manera que parezca que lo es. En temas generales puede ser más difícil darse cuenta de que no está diciendo algo verdadero.

Cadena de pensamiento

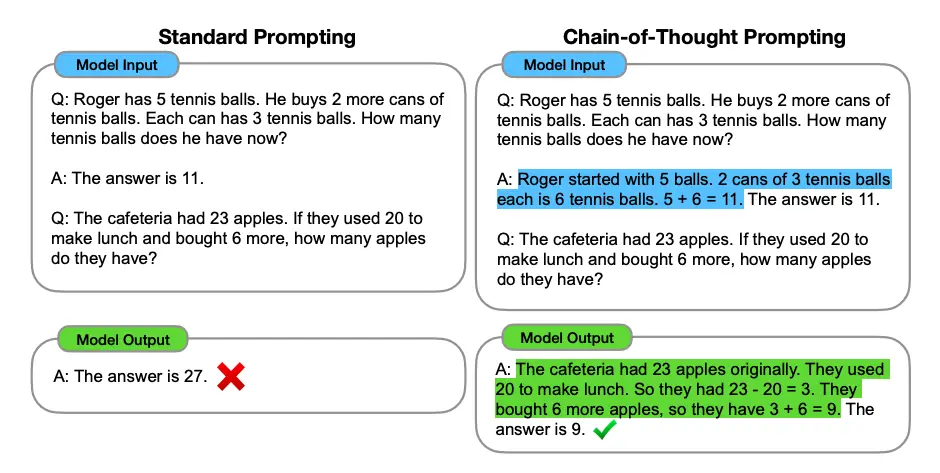

La cadena de pensamiento (Chain of Thought, CoT) en IA se refiere a dividir problemas complejos en pasos más pequeños y manejables. Este enfoque estructurado permite a los modelos de IA abordar y resolver desafíos que anteriormente eran demasiado intrincados. La CoT puede ser lineal, donde los pensamientos se conectan uno tras otro, o ramificada, donde los razonamientos se dividen en diferentes direcciones.

La cadena de pensamiento, para los modelos actuales, se introduce en los inputs del usuario para darle a la IA un modelo de respuesta razonada, por ejemplo:

En el modelo o1, se pretende que el propio modelo se aplique la cadena de razonamiento a medida que va generando las respuestas. Del árbol de posibles respuestas, se van analizando para descartar las que no se pueden validar y dar por buenas, de esta manera se llega a una respuesta más acertada y fiable.

De manera similar a cómo un ser humano puede pensar durante mucho tiempo antes de responder a una pregunta difícil, el modelo o1 utiliza una cadena de pensamiento cuando intenta resolver un problema. A través del aprendizaje por refuerzo, o1 aprende a perfeccionar su cadena de pensamiento y a refinar las estrategias que utiliza. Aprende a reconocer y corregir sus errores. Aprende a descomponer los pasos difíciles en pasos más simples. Aprende a probar un enfoque diferente cuando el actual no funciona. Este proceso mejora drásticamente la capacidad del modelo para razonar.

CoT ocultas

La generación del proceso CoT completo da como resultado secuencias de salida significativamente más largas, lo que genera mayores costos computacionales y latencia durante la inferencia. El proceso de "pensamiento", como se ha mencionado, no solo es lineal. Normalmente se compone de árboles con diferentes decisiones a tomar. Este desarrollo permite ver como piensa el modelo.

Desde OpenAI se dice:

«creemos que una cadena de pensamiento oculta presenta una oportunidad única para monitorear modelos. Suponiendo que sea fiel y legible, la cadena de pensamiento oculta nos permite "leer la mente" del modelo y comprender su proceso de pensamiento. Por ejemplo, en el futuro podríamos desear monitorear la cadena de pensamiento en busca de signos de manipulación del usuario. Sin embargo, para que esto funcione, el modelo debe tener la libertad de expresar sus pensamientos de forma inalterada, por lo que no podemos entrenar el cumplimiento de ninguna política o las preferencias del usuario en la cadena de pensamiento. Tampoco queremos que una cadena de pensamiento no alineada sea directamente visible para los usuarios.

Por lo tanto, después de sopesar múltiples factores, incluida la experiencia del usuario, la ventaja competitiva y la opción de continuar con el monitoreo de la cadena de pensamiento, hemos decidido no mostrar las cadenas de pensamiento sin procesar a los usuarios.»

Ventajas

Las ventajas de estas técnicas son que generar mejores resultados lo hacen más útil en campos como la investigación científica o el desarrollo de software, al poder generar mejor código de programación y operaciones matemáticas.

Por otra parte, este tipo de "pensamiento" debería hacer que el modelo pueda generar ideas creativas porque descartaría opciones que no tengan sentido, ayudar en la creación de contenidos con textos menos estandarizados y soporte a escritores.

Inconvenientes

En cambio, en los puntos donde es necesario disponer de una información verídica y fiable, como los chatbots de asistentes para empresas de servicios, los tiempos de espera en los chats puede hacer que los usuarios renuncien a continuar una conversación que no es fluida.

- Chain of Thoughts

https://arxiv.org - Hacker News

https://news.ycombinator.com - OpenAI model o1

https://openai.com