Warning: Undefined array key "typ" in /srv/vhost/diaridigital.net/home/html/sourcecode/main/articles.php on line 18

La explosión de la inteligencia

Tiempo de lectura: 5 minutos

El progreso de la inteligencia artificial no se parará a nivel humano. Según Leopold Aschenbrenner las AGIs (Inteligencia Artificial General) serán más inteligentes que los humanos y las tendremos antes que acabe esta década.

Consciencia de Situación

En un extenso documento publicado por uno de los gurús de la IA, Leopold Aschenbrenner, que trabajó en el equipo de superalineación de OpenAI, expone, entre otras cosas, la explosión de la la IA que nos llevará a tener AGI en esta década. El documento se titula Consciencia de Situación y es un ensayo de varios capítulos.

La consciencia de situación es la percepción de los elementos existentes en el entorno en un volumen de tiempo y espacio, la comprensión de su significado, y la proyección de su estatus en el futuro cercano. Por lo tanto el documento es una visión de futuro.

Personalmente creo que se precipitan. No porque la AGI no sea algo posible, pero no creo que se superen las limitaciones técnicas tan fácilmente, ni las barreras energéticas, ni se mantenga una financiación abismal o que nos quedemos sin datos.

Superalineación

Leopold trabajó en el equpo de superalineación de OpenAI. ¿Qué es la superalineación? En la web del equipo de superalineación de OpenAI dice que necesitamos avances científicos y técnicos para dirigir y controlar sistemas de inteligencia artificial mucho más inteligentes que nosotros.

Pues eso, controlar a los sistemas que son más inteligentes que los propios humanos. Hay que notar que dice necesitamos avances científicos y técnicos, porque a día de hoy no sabemos cómo hacerlo.

De tres a ocho años tendremos una máquina con la inteligencia general de un ser humano medio.

Marvin Minsk, 1970

2027

Según el documento, para finales de 2027 tendremos una AGI con capacidades de investigación por encima de los mejores humanos. Los llama automated AI researchers, aAIr para abreviar aquí. Podremos ejecutar millones de copias durante día y noche que hagan en un día el trabajo de investigación humana de un año.

Y tendrán estas ventajas:

- podrán leer todos los papers que se publiquen, ya que ahora es imposible leer todo lo que se publica en un campo de investigación

- podrán escribir millones de líneas de código complejo y debugarlo

- podrán hacer réplicas de aAIr ya entrenados

- podrán compartir contexto, colaborando mejor de lo que lo hacen los humanos

- producirán mejores modelos para tener mejores aAIr

También se enumeran los posibles cuellos de botella, como los límites computacionales actuales.

Finaliza el segundo artículo con este parágrafo: Una vez más debemos afrontar la posibilidad de una reacción en cadena. Quizás te suene especulativo. Pero entre los científicos de alto nivel de los laboratorios de IA, muchos ven una rápida explosión de inteligencia como sorprendentemente plausible. Pueden verlo. La superinteligencia es posible.

A mi entender, las IAs que lleguen a ser más inteligentes que los humanos significa que no están restringidas a las limitaciones que nos imponemos los humanos, de forma subconsciente, de manera que pueden llegar a soluciones de problemas en las que nunca hemos pensado. Pero a las que llegaremos con el tiempo. Yo a esto no lo llamaría ser más inteligentes, sino tener más libertad de buscar soluciones de forma algorítmica, aunque si aplicamos la propiedad humana de antropomorfizar, entonces temeremos a las AGIs. Vuelve Skynet.

Consumo de energía

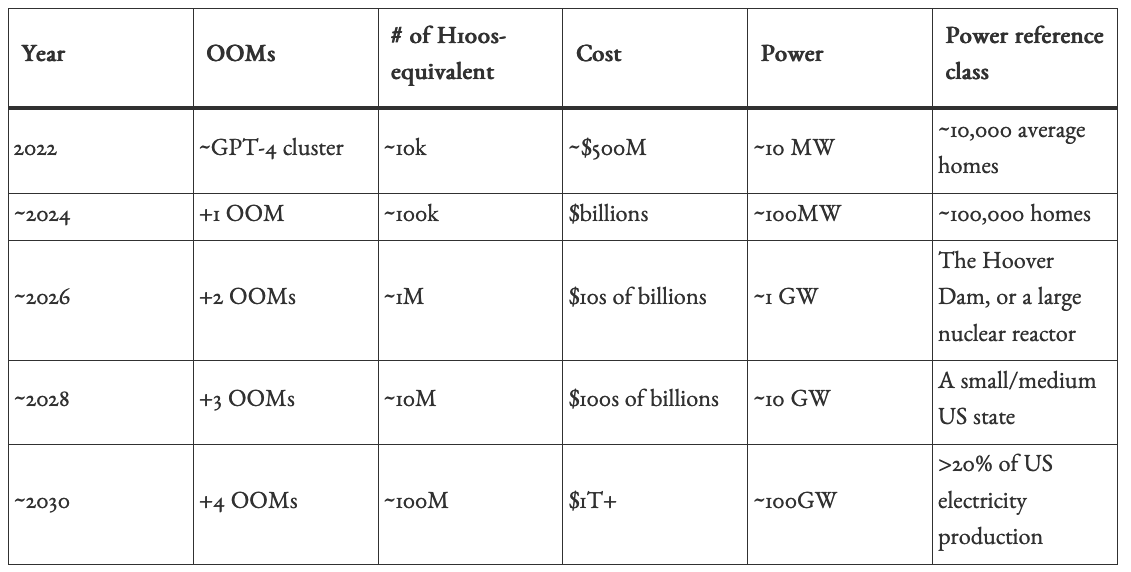

En el post Racing to the Trillion-Dollar Cluster se dan números que dan miedo. Uno de los que parece estar fuera de lugar es el coste de cómputo, tanto económico como energético.

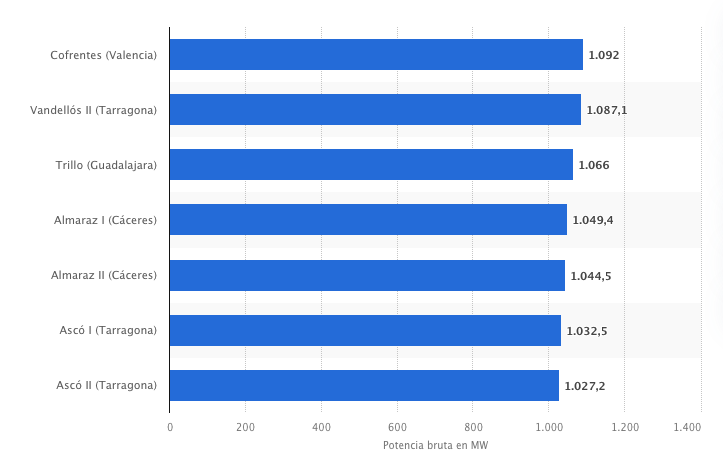

Para el año 2028, con un coste de centos de miles de millones de dólares, se espera un consumo de 10 GW. Una central nuclear media tiene una potencia de un poco más de 1 GW. Es decir, construyes un cluster de supercomputación e incluyes 10 centrales nucleares.

Pero es que para 2023 estima un coste de 1 billón de dólares y un consumo de 100 GW. A lo que añade: This may seem hard to believe—but it appears to be happening. Y es verdad, se puede leer en esta web: AWS adquiere el campus del centro de datos nucleares de Talen en Pensilvania.

Continúa el artículo diciendo que es factible la obtención de semejante energía, al menos en Estados Unidos, ya que disponen de abundante gas natural. O sea, quemar cantidades ingentes de gas para obtener AGIs que nos solucionen el problema de la energía. ¿Es eso? Si no morimos en el intento.

Imagino que la idea también viene de la genialidad de Sam Altman, que lo ve más fácil: simplemente usarán la fisión de helio para alimentar sus centros de datos. Y lo tendrán en 2028. Solo que no se conoce muy bien este tipo de fusión y los físicos no tienen ni idea de cómo conseguir una ganancia neta de energía, porque se invierte más de lo que se obtiene. Más con la doctora Sabine Hossenfelder.

Otro dato: el mayor proyecto internacional de energía de fusión tiene agendado probar el primer plasma en 2025 y la fusión completa en 2035. Luego, construir uno para producción.

Consumo de datos

Los grandes modelos actuales se han alimentado con toda la información disponible online. Además se han creado IAs que generan datos e imágenes para seguir entrenando los nuevos modelos con situaciones de la vida cotidiana, como las simulaciones de Tesla de atascos de tráfico o accidentes con personas.

Ya hemos visto que Meta va a echar mano de todos los datos de sus usuarios, pero esto se acaba. Aschenbrenner lo tiene claro, los robots buscarán datos y los problemas actuales en diseño de robots los solucionarán las primeras AGI y construiremos más robots para obtener más recursos.

Y consumiremos los pocos recursos para construirlos porque las AGIs nos ayudarán a solventar los problemas de falta de recursos que tengamos debido a la construcción de robots y al consumo energético para crear las AGI. ¿Fácil, no?

Los mejores algoritmos creados para generar AGIs no funcionarán si no tienen datos de los que aprender. Pero el conocimiento humano actual es limitado y las IAs han aprendido lo que sabemos nosotros. ¿Cómo podrán aprender más? ¿Haciendo nuevos descubrimientos a espalda de los humanos?

La guerra de la seguridad

En el siguiente artículo, Lock Down the Labs, se plantean los riesgos de la carrera para conseguir una AGI. Hasta ahora lo que hemos visto es que está en manos de grandes compañías o de administraciones de países de alto nivel económico. Es interesante observar cómo el oponente, el malo de la peli, es ahora China. Parece que se considera que la falta de escrúpulos de países no accidentales es un gran peligro, en lo que llama la preservación del mundo libre frente a los estados autoritarios.

El resto del planeta, no participa.

Dentro de teinta años, tendremos los medios tecnológicos para crear inteligencia superhumana. Poco después, la era humana habrá acabado

Vernor Vinge, 1993

Conclusión

Todo esto no creo que pase en 2028, tal vez en 2050 haya cambiado la economía mundial lo suficiente. Nadie dice que no llegue a ocurrir este despliegue de IA y tecnología ya que hay enormes cantidades de documentos científicos publicados que no se han estudiado porque no hay tiempo material para hacerlo y las IAs nos ayudarán. Además evitaremos cometer tantos errores, en todos los campos.

Y no tenemos en cuenta el "mal uso" que en ese camino se puede hacer de la IA o las AGI, desde actividad delictiva hasta influencia global maquinada por grupos o países. Actualmente sin regulación efectiva.

Pero, como humanidad, hemos de solucionar algunos problemas y no esperar que las AGI vengan a solucionarlos a este coste.

- Leopold Aschenbrenner

https://www.forourposterity.com - Superalineación

https://openai.com - Consciencia situacional

https://situational-awareness.ai - Amazon compra un campus nuclear

https://www.datacenterdynamics.com - Fusión nuclear de helio

https://www.datacenterdynamics.com - ITER

https://www.iter.org